Opinión

Opinión

Nueva constitución a través del manejo de la identidad

entre quienes se intentan informar en la lectura del texto, y quienes se guían por los medios (a través de los dispositivos) solo los separan dos tipos básicos -pero muy complejos en la fabricación algorítmica- de información: la ideología pasiva de lo que necesitan o quieren creer (no siendo el Yo que creen ser) y los temores arraigados que también generan tipos de identidades ficticias que decidirán no por lo que creen, sino por lo que los algoritmos les “ordenan” creer.

En el libro de ensayo de Flavia Costa titulado “Tecnoceno: algoritmos, biohackers y nuevas formas de vida” se puede leer en el epígrafe, lo siguiente:

- Los datos impulsan todo lo que hacemos. Cambridge Analytica utiliza datos para cambiar el comportamiento de la audiencia. Visite nuestras divisiones Comercial o Política para ver cómo podemos ayudarlo. (Texto de presentación en línea de la empresa Cambridge Analytica, 2017).

El término de antropoceno se inicia el año 2000 (Paul Crutzen), el cual plantea que la actividad humana sobre el planeta tiene tal nivel de impacto que estaría implicando transformaciones y cambios permanentes en los suelos, la atmósfera y los océanos. O sea, el humano ha llegado al punto de ser un “agente geológico” a partir, o con una velocidad creciente, desde mediados del siglo XX con el inicio de las radiaciones atómicas. Costa incorpora el concepto de tecnoceno, para plantear la tesis de la radical incidencia humana a partir de los usos tecnológicos con la aceleración desproporcionada que conocemos de acuerdo a nuestros alcances espacio temporales de vida.

La autora realiza recorridos foucaultianos de la biopolítica, para llevarlos a un presente de control (Big Data) “impensado” hace 30 años a través de la exponencial aceleración de la sofisticación algorítmica. Esto sería, una especie de “batalla biopolítica” en tipos de controles “políticos y epistémicos”. En este sentido Costa menciona que:

- El biopoder moderno, el poder sobre la vida que se inaugura en Europa entre los siglos XVI y XVII y que se dirige a regular, administrar, modular y conducir la vida de los individuos y las poblaciones, actúa no solo sobre los cuerpos biológicos, sobre sus fuerzas físicas, sus gestos y movimientos, sus rutinas cotidianas, sino también sobre sus creencias, sus deseos, sus intereses, sus estados de ánimo, sus afectos, sus gustos, sus decisiones.

En el caso específico del cambio epistémico, el concepto de “información” sería relevante para la generación de “relatividad” semántica, y esto es clave al momento del trabajo en las relaciones de poder para la “manipulación” informativa (acá no importa si esta información es real o no). La dependencia de los usos tecnológicos -pasivos o no- ha llevado y llegado al punto en donde la programación de enormes flujos de información, que todos y todas entregamos segundo a segundo, se nos ha devuelto de bruces hacia nuestros propios cuerpos en lo que creemos como deseos, gustos, decisiones políticas, etc., propias, cuando, en escalas casi inimaginables, la cantidad de individuos en el mundo que creen elegir lo que su voluntad “quiere” comienza a perderse en lo que los algoritmos hacen creer que quieren. Parece una distopía, pero es algo que está ocurriendo sin lugar a dudas. Un ejemplo de esto, y es a donde quiero llegar con esta columna, son las inclinaciones políticas de las poblaciones al momento de elegir una preferencia u otra. En el “mejor” de los casos, para quienes se informan, o lo intentan, los mecanismos de sistemas complejos dirigen y redirigen los contenidos reductibles a los intereses o preocupaciones intelectuales para incidir en la elección final. Si consideramos los casos en que (de forma preocupante) una gran cantidad de individuos cada vez lee menos, la información a través de aparatos y dispositivos culturales se hace más estandarizada. Entonces la apelación primitiva a los miedos y mínimas inclinaciones de una educación temprana (o culturización temprana) movilizan con la mínima información la relativización semántica, es decir: hacer creer que un hecho o un concepto falso es verdadero, por ejemplo -y claramente- en las campañas políticas.

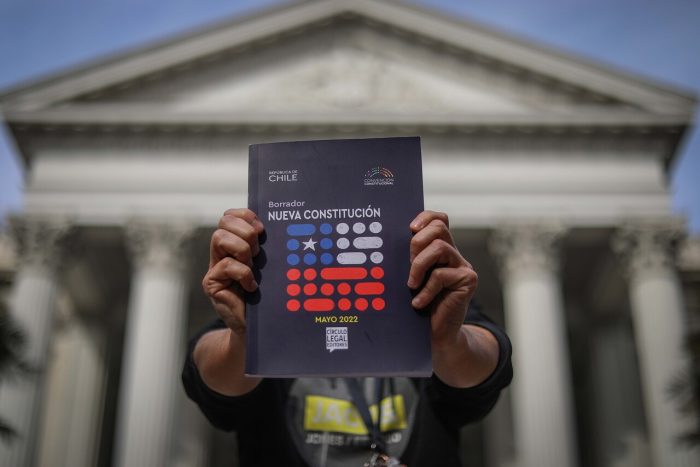

A pesar de que, racionalmente, es entendible esto, no me deja de alarmar el hecho, por ejemplo, de la información que circula sobre el nuevo texto constitucional en Chile que deberá aprobarse o rechazarse en votación obligatoria en septiembre. En este tema, la enorme cantidad de “información de manipulación semántica” ha sido de niveles ingentes, mostrando que hasta la información tecnodirigida mas ridícula, o claramente falsa y/o errónea, cala en una gran cantidad de la población. Esto último, considerando que en Chile ni siquiera se está utilizando la tecnología de punta en estos sistemas de control, pero con la tecnosemántica de segunda que se utiliza acá es suficiente para informar y distribuir esa “información tergiversada” y cambiada de acuerdo a los grupos de poblaciones (o campos) que se aferran a creer lo que creen que están pensando de acuerdo a lo que mencionaba antes en la apelación primitiva más básica, pero que nunca ha dejado de ser efectiva hasta ahora: los miedos. Y es este cóctel una tormenta perfecta (miedos, “información manipulada”, entrada en los códigos de comportamiento de los cuerpos con la sofisticación algorítmica, etc.), para que un sector de la población minoritario, con enormes temores de perder privilegios desproporcionados, utilicen grandes recursos económicos para invertir en la tergiversación semántica, o sea, en la creación de las reacciones en cadena de un creciente rechazo al nuevo texto constitucional, cambiándole el sentido de lo que el cuerpo del texto de este libro contiene.

Entonces, entre quienes se intentan informar en la lectura del texto, y quienes se guían por los medios (a través de los dispositivos), solo los separan dos tipos básicos -pero muy complejos en la fabricación algorítmica- de información: la ideología pasiva de lo que necesitan o quieren creer (no siendo el Yo que creen ser) y los temores arraigados que también generan tipos de identidades ficticias que decidirán no por lo que creen, sino por lo que los algoritmos les “ordenan” creer.

- El contenido vertido en esta columna de opinión es de exclusiva responsabilidad de su autor, y no refleja necesariamente la línea editorial ni postura de El Mostrador.